TurboQuant는 최근 AI 연구 커뮤니티에서 뜨겁게 회자된 논문이다. LLM의 메모리 문제를 수학적으로 풀어낸 이 논문에서 나는 한 가지 점에 주목했다. 핵심 재료가 수십 년 된 범용 기술이라는 사실이다.

이게 왜 중요한가. 엔지니어링 사고의 본질은 새로운 걸 만드는 것이 아니다. 이미 검증된 도구를 문제에 맞게 재조합하고, 그 조합이 왜 작동하는지 논리적으로 설명할 수 있을 때 진짜 솔루션이 나온다. TurboQuant는 AI 논문이지만, 이 사실을 가장 선명하게 보여주는 사례다. 이 글은 그 관점에서 읽는 TurboQuant다.

핫이슈 논문의 재료가 수십 년 된 기술이라면

TurboQuant가 해결하려는 문제는 LLM의 KV 캐시 메모리 폭증이다. AI가 대화 문맥을 기억하기 위해 쌓아두는 저장소가 대화가 길어질수록 폭발적으로 커지는 구조적 문제다.

이 문제를 풀기 위해 TurboQuant가 꺼내든 도구는 두 가지다.

첫 번째는 스칼라 양자화다. 연속적인 숫자를 유한한 구간으로 반올림해 압축하는 방식으로, MP3 음악 파일과 JPEG 이미지 압축이 모두 이 원리 위에 서 있다. 디지털 신호 처리의 기초 중에 기초다.

두 번째는 JL 정리(Johnson-Lindenstrauss Lemma) 다. 1984년에 나온 순수 수학 결과물로, 고차원 데이터를 저차원으로 줄여도 벡터 간 거리(내적)가 보존된다는 걸 증명한 정리다. 머신러닝·검색 시스템·데이터베이스 인덱싱 등 다양한 분야에서 수십 년간 차원 축소 도구로 쓰여왔다.

AI 커뮤니티를 달군 논문의 핵심 재료가 40년 된 수학 정리와 MP3 압축 기술이라는 사실은, 처음 들으면 조금 허탈하게 느껴질 수도 있다. 하지만 이게 바로 이 논문에서 배워야 할 핵심이다.

TurboQuant가 실제로 한 것 — 발명이 아닌 재조합

TurboQuant의 진짜 기여는 새로운 도구를 만든 게 아니다. 기존 두 도구를 LLM KV 캐시라는 특정 문제에 맞게 2단계로 조합하고, 그 조합에서 발생하는 오차를 수학적으로 제거할 수 있다는 걸 이론적으로 증명한 것이다.

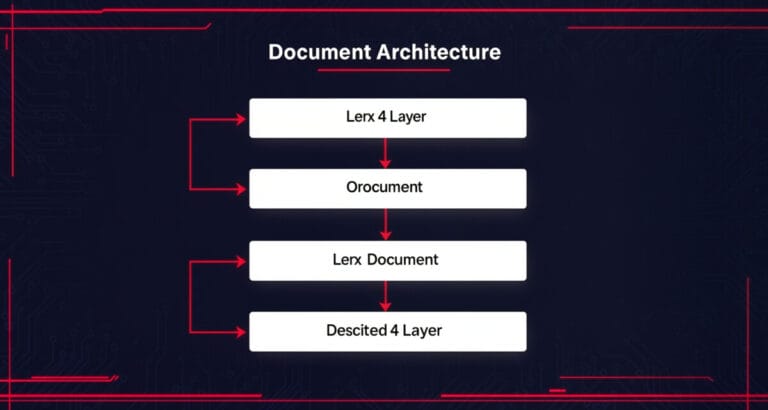

구조를 보면 명확하다.

| 단계 | 방법 | 역할 |

|---|---|---|

| 전처리 | 무작위 회전 | 데이터 분포 균일화 |

| 1단계 | 스칼라 양자화 | 초벌 압축 — 빠르고 단순 |

| 2단계 | QJL(JL 정리 기반) | 1단계 오차(잔차) 보정 |

| 결과 | — | 메모리 절감 + 정확도 유지 |

1단계에서 반올림으로 생긴 오차를 버리지 않고 측정한 뒤, 2단계에서 JL 정리를 이용해 보정한다. 이 조합이 수학적으로 편향 없이 작동한다는 걸 증명한 것이 TurboQuant가 논문으로서 기여한 부분이다.

새로운 재료가 아니라, 재료를 쓰는 순서와 방식, 그리고 그게 왜 옳은지에 대한 논리가 핵심이었다.

현장 엔지니어링도 정확히 이 구조다

이 이야기가 낯설지 않은 이유가 있다. 현장 엔지니어링이 원래 이렇게 돌아가기 때문이다.

장비 트러블슈팅을 예로 들어보자. 에러 없이 성능만 떨어지는 장비 앞에서 좋은 엔지니어는 새로운 진단 도구를 발명하지 않는다. 스왑 테스트로 범위를 좁히고, 파라미터 로그로 변곡점을 찾고, 동일 이력 장비와 비교한다. 이미 존재하는 방법론을 이 문제에 맞는 순서로 조합하는 것이다.

데이터 분석도 마찬가지다. 회귀분석, 가설검정, 상관관계 분석은 모두 수십 년 된 통계 도구다. 현장에서 가치를 만드는 건 새로운 알고리즘을 만드는 것이 아니라, 어떤 도구를 어떤 순서로 적용할지 아는 것이다. 그 판단의 근거가 도메인 지식이다.

TurboQuant가 낡은 도구로 AI 커뮤니티를 놀라게 한 것처럼, 현장 엔지니어도 기존 방법론의 재조합으로 문제를 푼다. 둘 다 같은 사고 구조 위에 서 있다.

재조합이 혁신이 되는 3가지 조건

물론 재조합이라고 다 혁신이 되는 건 아니다. TurboQuant를 보면 재조합이 가치를 만드는 조건 3가지가 보인다.

첫째, 문제를 정확히 정의했다. KV 캐시가 왜 커지는지, 어디서 오차가 생기는지, 무엇을 보존해야 하는지를 먼저 명확히 했다. 도구를 먼저 고른 게 아니라 문제를 먼저 해부했다.

둘째, 도구의 본질적 성질을 이해했다. JL 정리가 “내적을 보존한다”는 성질을 알고 있었기 때문에 오차 보정에 쓸 수 있었다. 도구를 표면적으로 아는 것과 본질적으로 아는 것의 차이가 조합의 질을 결정한다.

셋째, 왜 작동하는지 설명할 수 있었다. 단순히 “해보니 됐다”가 아니라 이론적으로 편향이 제거됨을 증명했다. 재현 가능하고, 다른 환경에서도 적용 가능한 이유다.

이 3가지는 논문에서만 유효한 게 아니다. 현장에서 좋은 솔루션을 제안할 때도 같은 조건이 요구된다. 문제 정의 → 도구 본질 이해 → 작동 근거 설명. 이 흐름이 갖춰졌을 때 재조합은 혁신이 된다.

핵심 요약

- TurboQuant는 40년 된 JL 정리와 MP3 압축 기술을 조합해 LLM 메모리 문제를 푼 논문이다

- 핵심 기여는 새로운 발명이 아니라 조합의 설계와 이론적 증명이다

- 현장 엔지니어링도 같은 구조 — 기존 방법론을 문제에 맞게 재조합하는 것이 실력이다

- 재조합이 혁신이 되려면 문제 정의 → 도구 본질 이해 → 작동 근거 설명 3단계가 필요하다

- AI를 공부하는 엔지니어라면 새로운 도구보다 조합 논리를 먼저 키워야 한다

[링크 제안]

TurboQuant가 풀려고 했던 LLM 양자화 문제 자체가 궁금하다면 아래 글에서 KV 캐시부터 2단계 압축 원리까지 정리했다.

도메인 지식이 AI 시대에도 핵심인 이유를 데이터 설계 관점에서 풀어낸 글이다. 재조합 사고와 맞닿아 있다.