AI 관찰가능성은 한 줄로 정의할 수 있다. “AI가 뭘 하고 있는지, 어디서 왜 실패했는지 볼 수 있는 구조.” 결과만 받아보는 방식으로는 AI를 제대로 쓸 수 없다. AI 관찰가능성이 확보돼야 비로소 개선이 시작된다. 이 글에서는 관찰가능성이 무엇인지, AI가 이 구조를 활용해 스스로 진화하는 원리를 짚고, 그럼에도 사람이 해야 할 역할이 무엇인지까지 정리한다.

AI 관찰가능성이란 무엇인가

공장 비유가 직관적이다. 불량품이 나왔다고 해보자.

관찰가능성이 낮은 공장은 불량이 났다는 사실만 안다. 어느 공정에서, 어떤 부품이, 왜 문제가 됐는지 알 방법이 없다. 결국 사람이 공장 전체를 뒤져야 한다. 관찰가능성이 높은 공장은 다르다. 공정마다 센서와 로그가 붙어 있어서 “3번 라인, 용접 공정, 온도 이상”처럼 원인이 바로 보인다.

AI 시스템도 똑같다. AI가 틀린 결과를 냈을 때, 어느 단계에서 무엇이 잘못됐는지 볼 수 있어야 고칠 수 있다. AI 관찰가능성이 없으면 결과만 보고 프롬프트를 바꾸는 시행착오만 반복된다.

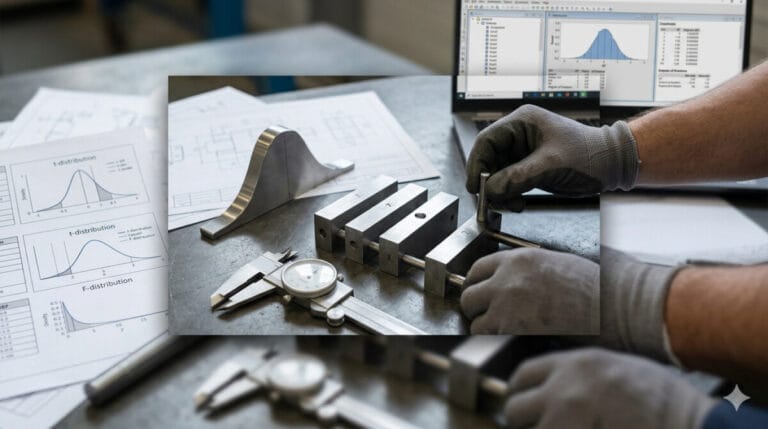

현장 엔지니어라면 이미 이 감각을 갖고 있다. 장비 이상을 진단할 때 파라미터 로그를 먼저 보는 이유가 바로 관찰가능성이다. 로그가 없으면 감으로 찍을 수밖에 없고, 감으로 찍은 진단은 재현이 안 된다.

무지성 프롬프팅이 한계인 3가지 이유

AI를 많이 쓰는 사람 중에 결과가 별로면 프롬프트를 조금 바꿔서 다시 시키는 방식을 반복하는 경우가 많다. 이 방식의 문제는 세 가지다.

첫째, 왜 실패했는지 모른다. 프롬프트를 바꿔서 결과가 좋아졌어도, 어떤 변화가 효과를 냈는지 알 수 없다. 다음번에 같은 상황이 와도 또 처음부터 시행착오를 반복해야 한다.

둘째, 개선이 축적되지 않는다. 관찰가능성 없이 결과만 보면 성공과 실패가 쌓이지 않는다. 경험이 늘어도 실력이 늘지 않는 구조다.

셋째, 피드백을 줄 지점이 없다. AI에게 “이게 왜 틀렸어?”라고 묻기 전에, 사람이 먼저 “어디가 왜 틀렸는지”를 알아야 한다. AI 관찰가능성이 없으면 피드백 자체가 불가능하다.

결론은 단순하다. 결과만 보는 사람은 AI를 소비하는 것이고, 과정을 보는 사람은 AI를 운용하는 것이다.

AI가 스스로 고치는 구조 — AHE가 보여준 것

2026년 발표된 AHE(Agentic Harness Engineering) 연구는 AI 관찰가능성의 가능성을 실험으로 증명했다. 핵심 아이디어는 명확하다. AI 에이전트가 자기 환경을 스스로 개선하지 못하는 이유는 능력 부족이 아니라 관찰가능성 부족이다.

AHE는 관찰가능성을 세 층으로 설계했다.

| 층 | 이름 | 역할 |

|---|---|---|

| 1층 | 컴포넌트 관찰가능성 | 시스템 프롬프트·도구·메모리 등 각 부품을 독립 파일로 분리 — 어떤 부품이 문제인지 바로 특정 가능 |

| 2층 | 경험 관찰가능성 | 수백만 토큰의 실행 기록을 요약→작업별 분석→상세 로그 계층으로 압축 — 필요한 깊이만 탐색 |

| 3층 | 결정 관찰가능성 | 수정할 때마다 “이렇게 바꾸면 이게 좋아질 것이다”라는 예측을 남기고, 다음 라운드에서 실제 결과와 대조 |

이 구조 위에서 AI 에이전트는 10회 반복만으로 사람이 직접 설계한 시스템보다 높은 성능을 냈다. AI 관찰가능성이 확보되자, 에이전트는 스스로 실패를 분석하고 환경을 개선하는 루프를 돌릴 수 있었다.

그래도 사람이 필요한 이유 — 회귀 맹점

여기서 오해하기 쉬운 부분이 있다. AI가 스스로 개선한다고 해서 사람이 필요 없어지는 건 아니다.

AHE 연구에서 흥미로운 한계가 드러났다. AI 에이전트는 “무엇을 고치면 성능이 좋아질지”는 무작위 대비 5배 수준으로 잘 예측했다. 하지만 “그 수정이 다른 곳에서 부작용을 낼지”는 무작위 대비 2배 수준에 그쳤다. 연구팀은 이를 회귀 맹점(regression blindness)이라고 불렀다.

쉽게 말하면 이렇다. AI는 1차 효과는 잘 보지만, 2차·3차 파급 효과는 잘 못 본다. 장비로 치면, 부품을 교체했을 때 그 부품이 좋아지는 건 알지만, 교체 때문에 다른 부품에 부하가 걸리는 건 미리 예측하지 못하는 것과 같다.

| 구분 | AI 단독 | 사람이 필요한 지점 |

|---|---|---|

| 실행 | ✅ 가능 | — |

| 환경 개선 | ✅ 점점 가능 | — |

| 부작용 예측 | ⚠️ 아직 한계 | ✅ 도메인 지식 기반 판단 |

| 최종 결정 | ⚠️ 맥락 부족 | ✅ 현장 경험 기반 판단 |

AI가 잘하는 것과 사람이 해야 하는 것이 나뉜다. 그 경계를 아는 사람이 AI를 제대로 쓰는 사람이다.

현장 엔지니어에게 AI 관찰가능성이 중요한 3가지 이유

AI 관찰가능성은 개발자만의 개념이 아니다. 현장에서 AI 도구를 쓰는 모든 사람에게 해당된다.

첫째, 도메인 지식이 감독의 무기다. AI가 생성한 결과가 맞는지 틀린지 판단하려면 해당 분야의 맥락을 알아야 한다. 데이터 설계에서 강조했듯, AI가 아무리 잘 분석해도 측정 지점이 틀렸으면 결론은 쓸모없다. 현장 경험이 바로 그 판단 기준이다.

둘째, 과정을 보는 습관이 AI 활용 수준을 가른다. 결과만 받아서 쓰는 사람과, AI가 어떤 근거로 그 결과를 냈는지 확인하는 사람은 시간이 갈수록 격차가 벌어진다. AI 관찰가능성을 의식하는 습관 하나가 그 차이를 만든다.

셋째, 부작용을 잡는 건 사람의 몫이다. AI는 회귀 맹점이 있다. 수정이 다른 곳에서 어떤 영향을 미칠지, 현장 전체 맥락에서 판단하는 건 도메인 지식을 가진 사람만 할 수 있다. AI가 잘 못 보는 바로 그 지점이, 현장 엔지니어가 가장 잘 볼 수 있는 지점이다.

AI 시대의 경쟁력은 프롬프트를 많이 아는 것이 아니다. AI가 무엇을 하고 있는지 이해하고, 어디가 틀렸는지 잡아낼 수 있는 도메인 지식이다. AI 관찰가능성은 그 감독자의 눈을 만드는 개념이다.

핵심 요약

- AI 관찰가능성이란 AI가 뭘 하고 있는지, 어디서 왜 실패했는지 볼 수 있는 구조다

- 결과만 보는 무지성 프롬프팅은 왜 실패했는지 모르기 때문에 개선이 축적되지 않는다

- AHE 연구는 관찰가능성 구조만 갖추면 AI가 스스로 환경을 개선할 수 있음을 실험으로 증명했다

- AI는 1차 효과는 잘 예측하지만 부작용(2차 효과)은 아직 잘 못 본다 — 이 지점이 사람의 역할이다

- 현장 엔지니어의 도메인 지식은 AI 감독자의 핵심 무기다

[링크 제안]

무지성 프롬프팅을 벗어나는 첫 번째 습관이 궁금하다면, AI에게 답을 달라기 전에 내 사고 구조를 먼저 검증받는 방법을 다룬 이 글을 이어서 읽어보자.

AI가 틀린 결과를 내도 왜 틀렸는지 모르는 상황, 즉 할루시네이션 문제를 구조적으로 잡고 싶다면 이 글이 바로 이어진다.

AHE 논문 원문이 궁금하다면 arxiv.org에서 직접 확인할 수 있다.